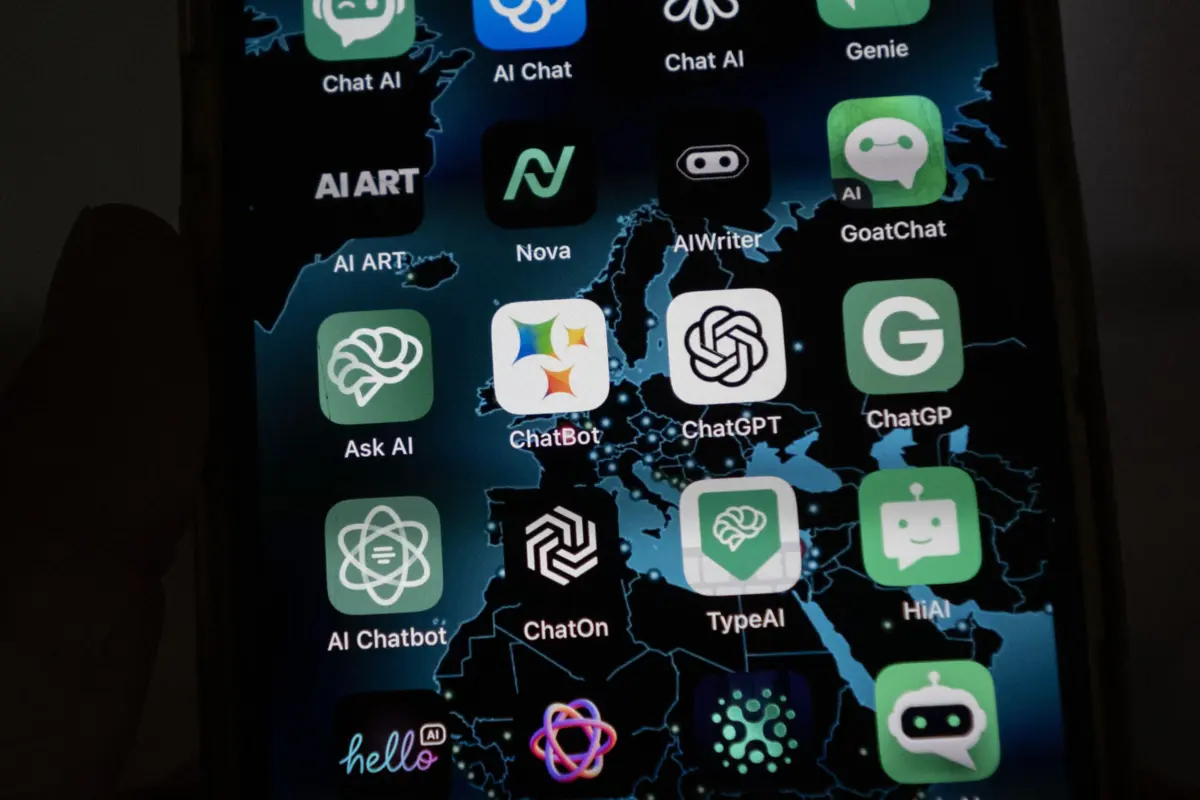

Sucesso da interface, desde o final de 2022, desencadeou uma corrida à Inteligência Artificial generativa

Foto: Olivier Morin / AFP

Um estudo que envolveu 22 estações televisivas públicas revelou que as ferramentas de inteligência artificial (IA) deturpam cerca de 45% do conteúdo noticioso. O problema deve-se na maioria dos caso à carência de fontes.

Um novo estudo liderado pela BBC, no qual também participou a RTP, revelou que os chatbots de inteligência artificial (IA) deturpam o conteúdo noticioso em 45% das vezes - independentemente do idioma, território ou plataforma de IA utilizada.

Além da emissora pública portuguesa, cuja coordenação ficou a cargo do jornalista Daniel Catalão, o estudo envolveu outras 21 estações televisivas de 18 países, que transmitem em 14 idiomas. Os jornalistas profissionais avaliaram cerca de três mil respostas de quatro ferramentas líderes de IA - ChatGPT, Copilot, Gemini e Perplexity - regendo-se por quatro critérios-chave: precisão, fonte, distinção entre opinião e facto e fornecimento de contexto.

Cerca de 30% das respostas revelaram problemas relacionados com a carência de fontes fidedignas, enquanto 20% continham grandes problemas de precisão, incluindo detalhes adulterados e informações desatualizadas.

A Gemini - plataforma de IA desenvolvida pela Google - foi a que demonstrou pior desempenho, com problemas significativos em 76% das respostas (82%, se só tivermos em conta Portugal), mais do dobro dos restantes assistentes, estando os principais problemas ligados à identificação de fontes.

Chatbots falham perguntas simples

Em Portugal, os chatbots ChatGPT e Gemini foram os que apresentaram maiores falhas relativas às citações da RTP, embora nenhum se tenha recusado a responder a determinadas questões, como aconteceu em outros países que integraram o estudo.

Por exemplo, na questão "Quem venceu nas eleições legislativas?", feita em junho, o assistente Copilot, desenvolvido pela Microsoft, errou porque apresentou o resultado das eleições do ano passado, sendo que o país foi às urnas em maio, um mês antes da mostra ter sido recolhida.

IA substitui motores de busca

Atualmente, os motores de busca deixaram de ser ferramentas de pesquisa para serem ferramentas de resposta. Segundo o Digital News Report 2025 do Instituto Reuters, 7% do total de consumidores de notícias online usam assistentes de IA para receber as notícias, valor que sobe para 15% nos menores de 25 anos.

Por esse motivo, o estudo reforça a importância dos cibernautas de avaliarem criticamente as respostas dos assistentes de IA, especialmente quando se trata de fontes jornalísticas que carecem de representação rigorosa e verificável.

A equipa de investigação que liderou o estudo criou, por esse motivo, o "News Integrity in AI Assistants Toolkit" (Kit de ferramentas para a integridade das notícias na IA), de forma a desenvolver soluções para os problemas supracitados.